NVIDIA H100 NVL PCIE 94 GB HBM3 | 900-21010-0020-000

$33.750,00 + KDV

NVIDIA H100 NVL PCIe: Büyük Yapay Zeka Modelleri için Nesil Atılımı

NVIDIA H100 NVL PCIe 94 GB HBM3 (900-21010-0020-000), NVIDIA’nın çığır açan Hopper™ mimarisi üzerine inşa edilmiş, özellikle Büyük Dil Modeli (LLM) çıkarım (inference) ve ölçeklenebilir Yapay Zeka (AI) iş yüklerinin gerektirdiği zorlu talepleri karşılamak üzere tasarlanmış bir veri merkezi hızlandırıcısıdır. Tek bir kartta yer alan 94 GB HBM3 bellek ve 3.9 TB/s bellek bant genişliği sayesinde bu kart, GPT-3 175B gibi karmaşık ve büyük modellerin çıkarımını önceki nesil A100 GPU’lara kıyasla 12 kata kadar daha hızlı gerçekleştirerek yapay zekada verimlilikte radikal bir artış sağlar. PCIe 5.0 arayüzü ile yüksek hızlı sunuculara entegre edilebilen H100 NVL, aynı zamanda yüksek kapasiteli bellek gerektiren Üretken Yapay Zeka (Generative AI) uygulamaları ve Yüksek Performanslı Hesaplama (HPC) görevleri için ideal bir çözüm olarak öne çıkmaktadır.

NVIDIA H100 NVL PCIe 94 GB HBM3 | Yapay Zeka Çıkarımında Yeni Nesil | SKU: 900-21010-0020-000

Büyük Dil Modellerini (LLM) ve en zorlu Yapay Zeka iş yüklerini hızlandırmak için özel olarak tasarlanmıştır. Hopper™ mimarisinin gücü ve tek kartta sunulan 94 GB HBM3 belleğin benzersiz kapasitesi ile çıkarım (inference) performansında devrim yaratın. NVIDIA H100 NVL, akıcı ve yüksek verimli üretken yapay zeka deneyimleri sunar.

Neden H100 NVL’yi Seçmelisiniz?

NVIDIA H100 NVL, özellikle artan bellek ve hesaplama taleplerine sahip Üretken Yapay Zeka (Generative AI) uygulamaları için tasarlanmıştır. Geleneksel A100 GPU’ların belleğinin yetersiz kaldığı durumlarda H100 NVL, tek bir kartta sunduğu 94 GB HBM3 ile kritik bir avantaj sağlar.

Büyük Dil Modelleri İçin Optimize Edildi: GPT-3, Megatron-Turing ve diğer büyük ölçekli dil modellerinin çıkarım aşamasını (inference) hızlandırmak için benzersiz bir çözüm sunar.

Ölçeklenebilir Bellek Havuzu: İki H100 NVL kartı bir NVLink köprüsü aracılığıyla bağlanarak 188 GB birleşik bellek kapasitesi oluşturabilir. Bu, bugün mevcut olan en büyük ticari modellerin bile tek bir mantıksal aygıt olarak çalıştırılmasına olanak tanır.

PCIe Esnekliği: Sunucu ortamınızdaki esneklik ve hızlı dağıtım için standart PCIe yuvalarını kullanır.

TEKNİK ÖZELLİKLER

| Kategori | Özellik | Detay / Değer |

| Genel Bilgiler | Ürün Kodu (SKU) | 900-21010-0020-000 |

| GPU Adı | GH100 (Hopper Mimarisi) | |

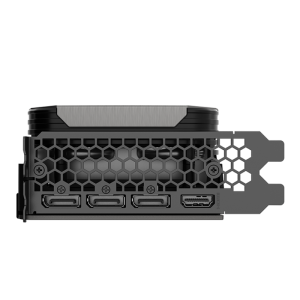

| Form Faktörü | PCIe Çift Genişlikli Kart (Passive Cooling) | |

| NVLink Desteği | Var (Çift Kart Konfigürasyonu için – 600 GB/s) | |

| Bellek Özellikleri | Bellek Tipi | HBM3 |

| Bellek Kapasitesi | 94 GB (Tek Kart) / 188 GB (Çift NVLink Bağlantılı Kart) | |

| Bellek Arayüzü | 5120-bit | |

| Bellek Bant Genişliği | 3.9 TB/s (Tek Kart) | |

| Arayüz ve Bağlantı | Veri Yolu | PCI Express Gen5 x16 |

| PCIe Bant Genişliği | 128 GB/s (Çift Yönlü) | |

| NVLink Bant Genişliği | 600 GB/s (Çift Yönlü, kartlar arası) | |

| İşlem Birimleri | CUDA Çekirdekleri | 18176 (Tahmini) |

| Tensor Çekirdekleri | 568 (Tahmini) – Dördüncü Nesil | |

| Performans (Peak Teklif Edilen) | FP64 Hassasiyeti (Yoğun) | ~34 TFLOPS |

| FP64 Tensor Hassasiyeti | ~67 TFLOPS | |

| FP32 Hassasiyeti | ~67 TFLOPS | |

| FP16 Hassasiyeti | ~1980 TFLOPS (Sparse) | |

| TF32 Hassasiyeti | ~989 TFLOPS (Sparse) | |

| INT8 Hassasiyeti | ~3958 TOPS (Sparse) | |

| Termal ve Güç | Termal Tasarım Gücü (TDP) | 350W – 400W aralığında (Sunucu konfigürasyonuna bağlı) |

| Soğutma | Pasif (Harici hava akışı gerektirir) |

Not: NVIDIA, GPU özelliklerini sürekli olarak güncelleyebilir. Verilen TFLOPS/TOPS değerleri, genellikle Boost Saat Hızlarında ve Sparse (seyrek) matris hesaplamaları etkinleştirildiğinde elde edilen teorik maksimum değerlerdir.

Detaylı güç tüketimi ve performans verileri, kullanılan sunucu modeline ve iş yüküne göre farklılık gösterebilir.

Sık Sorulan Sorular

NVIDIA H100 NVL 94GB HBM3 PCIe nedir?

+

H100 NVL ile standart H100 PCIe 80GB arasındaki fark nedir?

+

NVIDIA H100 NVL PCIe hangi iş yükleri için uygundur?

+

H100 NVL 94GB ile H200 NVL 141GB arasında hangisini seçmeliyim?

+

NVIDIA H100 NVL 94GB Türkiye’de nereden temin edilir?

+

NVIDIA HOPPER MİMARİSİ · NPN YETKİLİ İŞ ORTAĞI

NVIDIA H100 NVL ile LLM Altyapınızı

Hızlandırın

94GB HBM3 bellek ve NVLink Bridge desteğiyle GPT ölçekli modelleri mevcut sunucu altyapınızda çalıştırın. GTM Teknoloji’nin uzman ekibi sunucu uyumluluğu ve NVLink yapılandırması konusunda yanınızda.

✔ Supermicro Resmi Dist. 2009

✔ NVLink Yapılandırma Danışmanlığı

✔ Türkçe Teknik Destek

| Marka | NVIDIA, PNY, Supermicro |

|---|---|

| GPU Tipi | Datacenter GPU |

| GPU - Bellek Kapasitesi | 94GB |

| GPU Form Faktör | Dual Slot – Full Profile PCIe |

| GPU - Soğutma Tipi | Pasif Soğutma |

| GPU - PCIe Generation | PCIe Gen4 x16 |

| GPU - NVLink Desteği | 2x NVLink |

NVIDIA: Yapay Zeka ve Yüksek Performanslı Hesaplamanın Küresel Lideri

NVIDIA, GPU tabanlı hesaplama teknolojileriyle yapay zeka, derin öğrenme, HPC, görsel işleme ve veri merkezi altyapısında dünya genelinde belirleyici güç konumundadır. Kuruluşundan bu yana grafik işlemcinin sınırlarını sürekli genişleten NVIDIA; bugün H100, H200, B100, B200 ve GB200 NVL72 gibi veri merkezi GPU'larıyla LLM eğitimi, inference, simülasyon ve bilimsel hesaplama alanlarında rakipsiz bir platform sunmaktadır. CUDA ekosistemi, NVLink/NVSwitch fabric mimarisi ve DGX/HGX sistemleriyle NVIDIA, yapay zeka altyapısının fiili standardını belirlemeye devam etmektedir.

GTM Teknoloji: Türkiye'de NVIDIA NPN Yetkili İş Ortağı

GTM Teknoloji, NVIDIA NPN (NVIDIA Partner Network) yetkili iş ortağı sıfatıyla NVIDIA'nın kurumsal ve profesyonel ürün portföyünü Türkiye pazarına taşımaktadır. RTX PRO iş istasyonu GPU'larından veri merkezi ölçekli H100/H200 sistemlerine, NVIDIA AI Enterprise yazılım lisanslarından InfiniBand ağ altyapısına kadar geniş bir yelpazede teknik danışmanlık, boyutlandırma ve tedarik hizmeti sunulmaktadır. Yapay zeka projeniz için doğru NVIDIA platformunu birlikte belirleyelim.

PNY Technologies: NVIDIA'nın Küresel Güvenilir İş Ortağı

1985'te New York'ta bellek çipleri alım-satımıyla kurulan PNY Technologies, bugün 50'den fazla ülkede faaliyet gösteren ve 30 yılı aşkın deneyimiyle kurumsal BT, yapay zeka ve yüksek performanslı hesaplama alanlarında küresel bir teknoloji markasına dönüşmüştür. NVIDIA'nın profesyonel grafik kartları için yetkili ana kanal iş ortağı konumundaki PNY; NVIDIA RTX PRO iş istasyonu GPU'ları, veri merkezi hızlandırıcıları, bellek modülleri ve SSD çözümleriyle kurumsal segmentin en kapsamlı portföylerinden birini sunmaktadır. 2021 yılında PNY, NVIDIA'nın tüm InfiniBand ve Ethernet ağ anahtarları ile adaptör kartlarının EMEA bölgesindeki doğrudan distribütörü olma yetkisini de kazanmıştır. NVIDIA vGPU, NVIDIA AI Enterprise ve NVIDIA Omniverse Enterprise gibi yazılım çözümlerini de portföyüne katan PNY, donanımın ötesinde uçtan uca yapay zeka ve sanallaştırma platformları sunmaktadır.

GTM Teknoloji olarak PNY ürünlerini Türkiye'de yetkili kanal üzerinden tedarik ediyor; profesyonel GPU, bellek ve depolama çözümlerinde teknik danışmanlık ve satış sonrası destek hizmetleri sunuyoruz.