MAGNETAR Nvidia HGX H200 8-GPU NVlink Yapay Zeka (AI) Server

Magnetar HGX H200 8-GPU

Magnetar AI Nvidia HGX H200 8-GPU Sunucu: Dünyanın en büyük dil modelleri ve en zorlu HPC iş yükleri için tasarlanmış, eşi benzeri olmayan bir hesaplama gücü sunar. 141 GB HBM3e Bellek ve 4.8 TB/sn Bant Genişliği ile desteklenen 8x H200 GPU çekirdeği, yapay zeka eğitim sürelerinizi rekor seviyelere düşürür.Büyük ölçekli üretken yapay zeka, derin öğrenme ve bilimsel araştırmalarda yeni bir dönemi başlatan, veri merkezi altyapınız için geleceğin platformudur.

Hızlı Yapılandırma ve Teklif

Projelerinize özel GPU, RAM ve Depolama konfigürasyonları ile anında fiyat teklifi alın.

- ✅ 8x 141GB NVIDIA Tensor Core GPU | Total 1.128GB GPU Memory

- ✅ Intel Xeon Gen5 veya AMD EPYC 9005 Seçenekleri

- ✅ DDR5 5600Mhz 4TB Bellek Seçenekleri

- ✅ 8x 400G Infiniband | Nvidia BlueField-3 DPU Seçenekleri

Geleceğin Hesaplama Mimarisi

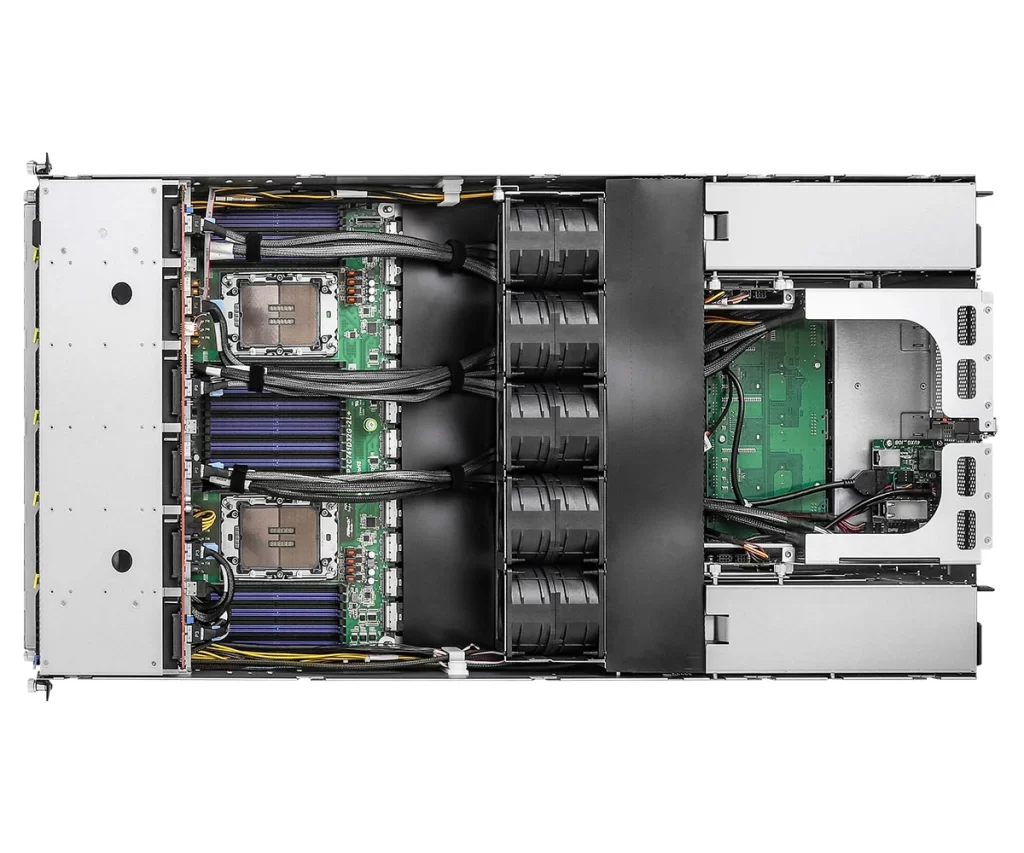

Magnetar AI NVIDIA HGX H200 Gücü: Sunucu, Büyük Dil Modelleri (LLM’ler), derin öğrenme ve üretken yapay zeka eğitimleri için tasarlanmış, 8 adede kadar NVIDIA H200 Tensor Çekirdek GPU barındırır. Bu çekirdekler, sadece yüksek çekirdek sayısı değil, aynı zamanda rekor düzeyde hızlı hesaplama gücü sağlar.

LLM'lerde Çığır Açan Verimlilik

Yapay Zeka Eğitiminde Rekor Hızlanma: Bu sunucu, üretken yapay zeka ve LLM çıkarımında önemli performans artışları sunar. Özellikle, Llama2 gibi popüler Büyük Dil Modellerinde 1.9 kata kadar daha hızlı çıkarım performansı sağlayarak, model dağıtımınızı ve hizmet verme hızınızı (throughput) maksimuma çıkarır.

Kritik Kurumsal İş Yükleri İçin Geleceğe Hazır Platform

Yeni Nesil Platform Desteği: Sistem, ister AMD EPYC 9005/9004 ister en yeni Intel Xeon 6. Nesil / 4.-5. Nesil Scalable platformu olsun, en yüksek işlemci performansını sunacak şekilde optimize edilmiştir. Bu, iş yükünüze en uygun CPU-GPU kombinasyonunu seçme esnekliği sağlar.

Magnetar AI – NVIDIA HGX H200 8-GPU NVLink Specifications

| GPU | 8x NVIDIA H200 Tensor Core GPUs |

| GPU Memory | 1128GB total GPU memory |

| Performance | 32petaFLOPS FP8 |

| Power Consumption | ~10,2kW max |

| CPU | Intel Platform: 2x Intel® Xeon® 8480C Processors AMD Platform: 2x AMD EYC 9654 Processors ** Fully Customizable |

| System Memory | Up to 2TB |

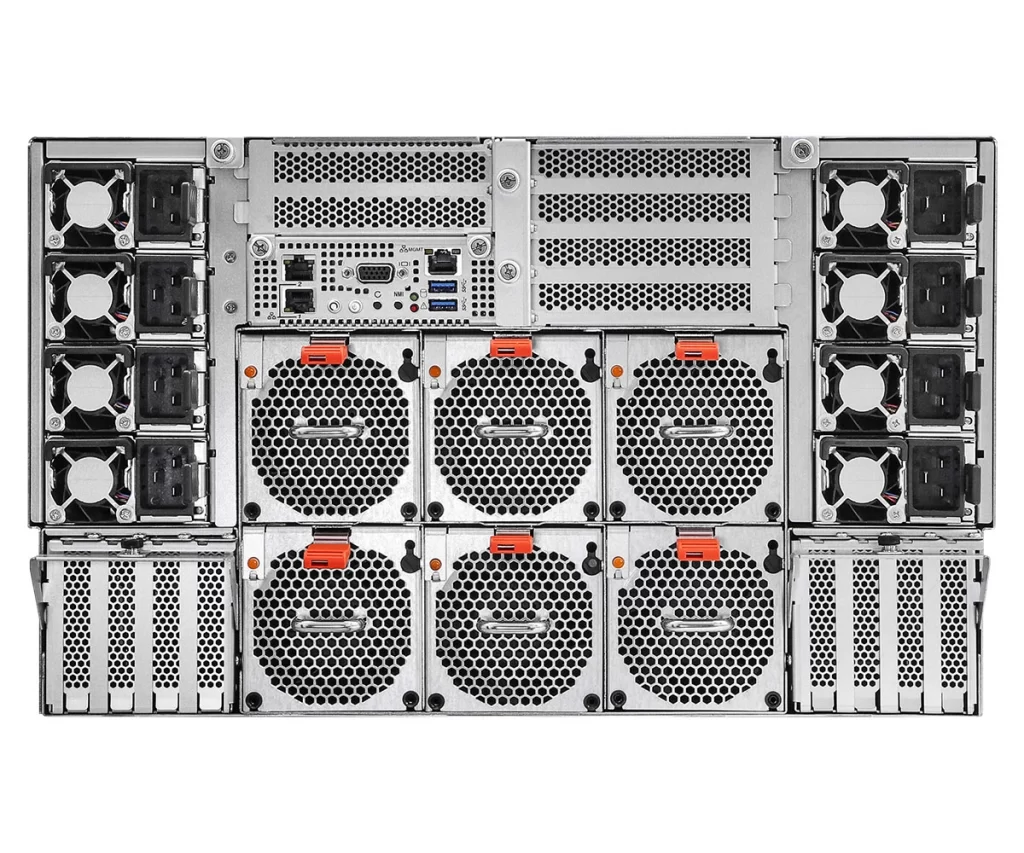

| Networking (optional) | 4x OSFP ports serving 8x single-port NVIDIA ConnectX-7 VPI Up to 400Gb/s NVIDIA InfiniBand/Ethernet |

| Management Network | 10Gb/s onboard NIC with RJ45 100Gb/s dual-port ethernet NIC Host baseboard management controller (BMC) with RJ45 |

| Storage | OS: 2x 1.9TB NVMe M.2 Internal storage: 8x 3.84TB NVMe U.2 ** Fully Customizable |

| Software (Optional | not Included) | NVIDIA AI Enterprise – Optimized AI Software NVIDIA Mission Control – AI Data Center Operations and Orchestration with NVIDIA Run:ai Technology Ubuntu – Operating System |

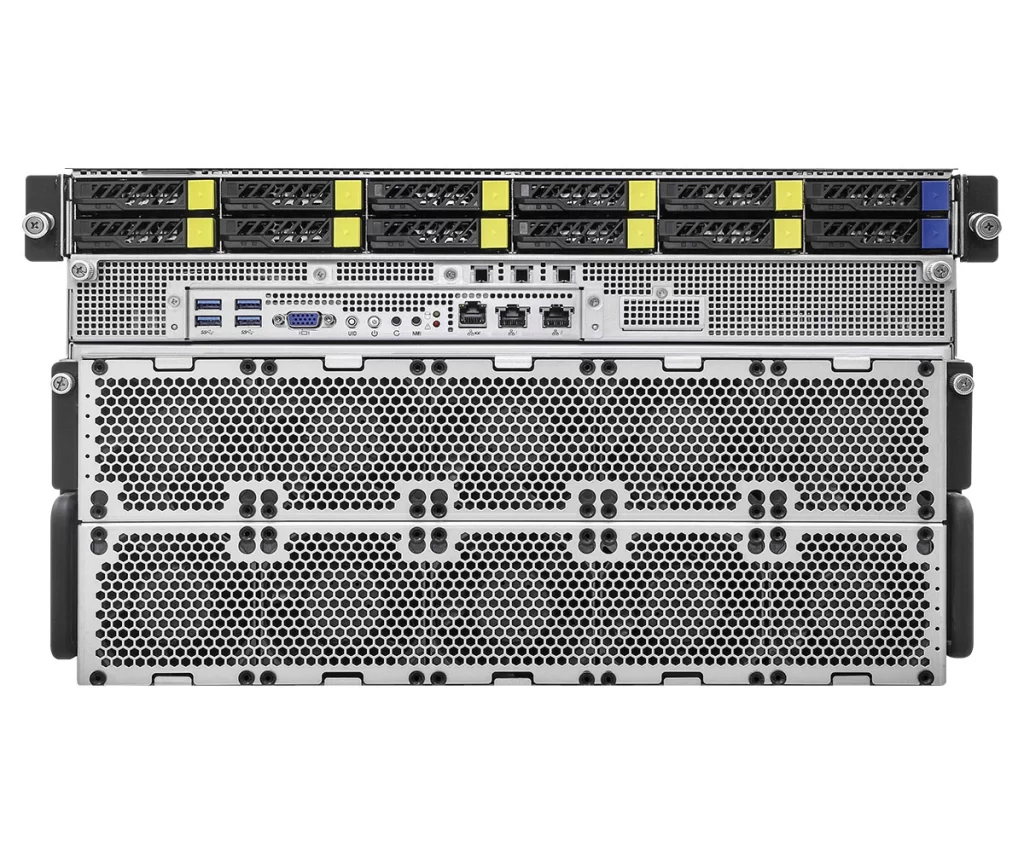

| Rack Units (RU) | 6 RU |

| System Dimensions | 930 x 448 x 264.7mm (36.6” x 17.6” x 10.4”) |

| Operating Temperature | Operation temperature: 10°C ~ 35°C / Non operation temperature: -40°C ~ 70°C |

| Enterprise Support | Three-year Enterprise Business-Standard Support for hardware Optional Five-year Enterprise Business-Standard Support for hardware and software |

Geleceğe Hazır mısınız?

Yeni nesil bilgi işlem gücüyle tanışın. Yapay zekâ, HPC ve veri yoğun iş yükleri için optimize edilmiş en güçlü sistemleri keşfedin.

Şimdi GTM Teknoloji ile iletişime geçin, yapay zeka sunucu profesyonellerimiz ihtiyacınıza en uygun çözümü üretsin.