NVIDIA: Yapay Zeka ve Yüksek Performanslı Hesaplamanın Küresel Lideri

NVIDIA, GPU tabanlı hesaplama teknolojileriyle yapay zeka, derin öğrenme, HPC, görsel işleme ve veri merkezi altyapısında dünya genelinde belirleyici güç konumundadır. Kuruluşundan bu yana grafik işlemcinin sınırlarını sürekli genişleten NVIDIA; bugün H100, H200, B100, B200 ve GB200 NVL72 gibi veri merkezi GPU’larıyla LLM eğitimi, inference, simülasyon ve bilimsel hesaplama alanlarında rakipsiz bir platform sunmaktadır. CUDA ekosistemi, NVLink/NVSwitch fabric mimarisi ve DGX/HGX sistemleriyle NVIDIA, yapay zeka altyapısının fiili standardını belirlemeye devam etmektedir.

GTM Teknoloji: Türkiye’de NVIDIA NPN Yetkili İş Ortağı

GTM Teknoloji, NVIDIA NPN (NVIDIA Partner Network) yetkili iş ortağı sıfatıyla NVIDIA’nın kurumsal ve profesyonel ürün portföyünü Türkiye pazarına taşımaktadır. RTX PRO iş istasyonu GPU’larından veri merkezi ölçekli H100/H200 sistemlerine, NVIDIA AI Enterprise yazılım lisanslarından InfiniBand ağ altyapısına kadar geniş bir yelpazede teknik danışmanlık, boyutlandırma ve tedarik hizmeti sunulmaktadır. Yapay zeka projeniz için doğru NVIDIA platformunu birlikte belirleyelim.

SYS-222GS-NB3OT-ALC Supermicro 2U NVIDIA HGX B300 8-GPU OCP GPU Server

DP Intel 2-OU (OCP ORV3) Liquid-Cooled System with NVIDIA HGX B300 8-GPU (complete rack and onsite service are required)

Key Features

- 21” OCP ORV3 Rack compatible, 1400A busbar with power shelves, DC-SCM Support

- Dual Intel® Xeon® 6700 series processors with P-cores, up to 350W TDP

- NVIDIA HGX B300 8-GPU with 5th Generation NVLink® 1.8TB/s, 2.3TB of HBM3e GPU memory per system

- 8x NVIDIA ConnectX®-8 SuperNICs, up to 800Gb/s, up to two NICs for North/South traffic

- 32x DIMMs with up to 8TB at 5200MT/s or up to 4TB at 6400MT/s DDR5 RDIMM

- 8x Hot-swap E1.S NVMe storage drive bays and 2x M.2 NVMe boot drives

- 2x 10GbE RJ45 via AIOM card

Supermicro IoT SuperServer Nvidia Jetson Orin NX Module ARS-E103-JONX-H2-01-G2 – Hazır Konfigurasyon

Supermicro ARS-E103-JONX-H2-01-G2, NVIDIA Jetson Orin™ NX

modülü ile 157 TOPS yapay zeka işlem kapasitesi sunan kompakt, fansız bir Edge AI platformudur. 8 çekirdekli ARM Cortex-A78AE işlemcisi ve 16 GB ECC LPDDR5X belleğiyle donatılan sistem; endüstriyel ortamlar için -25°C ile +60°C arasında güvenilir çalışma sağlar. 1× 10GbE ve 4× 1GbE (PoE opsiyonel) ağ bağlantısının yanı sıra CANBus, RS232/422/485 seri portlar ve 4× DI / 4× DO dijital G/Ç terminalleri ile geniş endüstriyel entegrasyon imkânı sunar. 185 × 80 × 140 mm boyutlarındaki fansız tasarımı; perakende AI, akıllı güvenlik, ulaşım sistemleri ve endüstriyel IoT uygulamaları için ideal bir çözümdür.

NVIDIA Spectrum-2 Open Ethernet Switch -Nvidia MSN3700-VS2F

- >Veri Hızı : 200 GbE

- >Bağlantı Noktaları : 32.0

- >İşletim Sistemi : Onyx/Cumulus Linux/ONIE

- >Ağ Arayüzü : QSFP56

- Supermicro Product Code Name: SSE-SN3700C

Nvidia SN3000 Serisi – Datasheet

NVIDIA DGX Spark AI Desktop Cluster Paketi | 2 DGX Spark Ünitesi | 200G QSFP56 Ethernet DAC Kablo

Orijinal fiyat: $12.500,00.$11.490,00Şu andaki fiyat: $11.490,00. + KDVNVIDIA DGX Spark Paketi | Yapay Zeka Süper Bilgisayar Paketi — 2xDGX Spark, 1x200G QSFP56, 0,5m Ethernet DAC kablosu

NVIDIA DGX Spark Paketi, iki adet NVIDIA DGX Spark Kişisel Yapay Zeka Süper Bilgisayarı ve bunlar arasında doğrudan bağlantı için yüksek performanslı bir DAC kablosu içeren, sorunsuz yapay zeka hesaplama ölçeklendirmesi için tasarlanmıştır. DAC kablosu, sistemlerin donanım özellikleriyle uyumlu, istikrarlı ve yüksek hızlı bağlantı sağlayarak, yapay zeka model eğitimi ve hesaplama görevleri için çift üniteli dağıtımı basitleştirir.

NVIDIA DGX Spark AI Desktop | Masaüstü Yapay Zeka LLM Sistemi

Orijinal fiyat: $5.950,00.$5.750,00Şu andaki fiyat: $5.750,00. + KDVNVIDIA DGX Spark AI Desktop, veri merkezi sınıfı yapay zeka gücünü masaüstünüze getiren devrim niteliğinde bir çözümdür. NVIDIA DGX güvenilirliği ile optimize edilmiş bu kompakt sistem, büyük dil modellerini (LLM) yerel olarak çalıştırmak, sıfırdan eğitmek ve yüksek performanslı çıkarım (inference) yapmak için tasarlanmıştır.

Ayrıca 2 adet DGX Spark ‘ın doğrudan bağlantılı “DGX Spark Cluster” paketi de alabilir ve yapay zeka hesaplama gücünüzü ölçekleyebilirsiniz.

İNCELE..

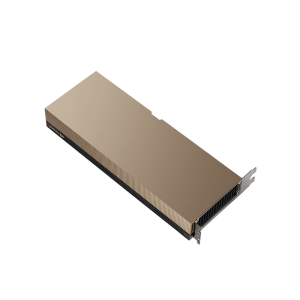

NVIDIA H100 NVL PCIE 94 GB HBM3 | 900-21010-0020-000

$33.750,00 + KDVNVIDIA H100 NVL PCIe: Büyük Yapay Zeka Modelleri için Nesil Atılımı

NVIDIA H100 NVL PCIe 94 GB HBM3 (900-21010-0020-000), NVIDIA’nın çığır açan Hopper™ mimarisi üzerine inşa edilmiş, özellikle Büyük Dil Modeli (LLM) çıkarım (inference) ve ölçeklenebilir Yapay Zeka (AI) iş yüklerinin gerektirdiği zorlu talepleri karşılamak üzere tasarlanmış bir veri merkezi hızlandırıcısıdır. Tek bir kartta yer alan 94 GB HBM3 bellek ve 3.9 TB/s bellek bant genişliği sayesinde bu kart, GPT-3 175B gibi karmaşık ve büyük modellerin çıkarımını önceki nesil A100 GPU’lara kıyasla 12 kata kadar daha hızlı gerçekleştirerek yapay zekada verimlilikte radikal bir artış sağlar. PCIe 5.0 arayüzü ile yüksek hızlı sunuculara entegre edilebilen H100 NVL, aynı zamanda yüksek kapasiteli bellek gerektiren Üretken Yapay Zeka (Generative AI) uygulamaları ve Yüksek Performanslı Hesaplama (HPC) görevleri için ideal bir çözüm olarak öne çıkmaktadır.

Supermicro AS-8126GS-NB3RT: NVIDIA HGX B300 ve Çift AMD EPYC™ İşlemcili 8U Yapay Zeka Sunucusu

Supermicro AS-8126GS-NB3RT, AMD EPYC 9005 çift işlemci ve Nvidia HGX B300 NVL8 8-GPU 2.3TB HBM3e belleğe sahip amiral gemisi 8U GPU sunucu çözümüdür. NVIDIA HGX B300 (8-GPU) ve Çift AMD EPYC™ 9005/9004 işlemcilerle donatılmıştır. Büyük ölçekli Yapay Zeka (AI) eğitimi, Derin Öğrenme ve HPC (Yüksek Performanslı Hesaplama) iş yükleri için rakipsiz bir güç sunar. 6TB DDR5 bellek ve 800GbE ultra hızlı ağ bağlantısı ile veri merkezinizin performansını zirveye taşıyın.

Supermicro AS-A126GS-TNBR | NVIDIA HGX B200 8-GPU Yapay Zeka AI ve HPC Sunucusu

Supermicro AS-A126GS-TNBR (10U), AMD EPYC 9005 işlemcilerle donatılmış Nvidia HGX B200 8-GPU temelli, 1.4TB GPU Bellek sağlayan büyük ölçekli Yapay Zeka (AI) eğitimi ve Yüksek Performanslı Hesaplama (HPC) iş yükleri için tasarlanmış, hava soğutmalı bir GPU sunucusudur.

Supermicro SYS-A21GE-NBRT | Intel® Xeon® İşlemcili 8x NVIDIA HGX B200 SXM AI Sunucu

En yeni 8x NVIDIA HGX B200 GPU 8-GPU 1.4TB ile güçlendirilmiş Supermicro SYS-A21GE-NBRT 10U sunucu, LLM Eğitimi ve Yüksek Performanslı Hesaplama (HPC) iş yükleriniz için üstün ölçeklenebilirlik sunar. Titanyum verimlilik.

GOLD SERİSİ HAZIR KONFİGURASYON:

- CPU: Dual Intel® Xeon® Platinum 8570 Processor (56-Cores)

- Chassis: 10U / 1 Node

- Drive: 2 1.9TB M.2 NVMe + 8 3.8TB U.3 NVMe

- RAM: 32 96GB DDR5-5600 RDIMM Memory

- GPU: 8 NVIDIA HGX B200

- Network Ports: 8 400GbE OSFP + 1 200GbE DPU + 2 10GbE RJ45 LAN Ports

SYS-A21GE-NBRT-G1 Gold Serisi önceden yapılandırılmış (hazır konfigürasyon) modelini tercih ederek, özel siparişlerdeki uzun bekleme sürelerini ortadan kaldırabilir ve sisteminizi çok daha hızlı bir şekilde devreye alabilirsiniz.

Supermicro SYS-821GE-TNHR | Intel® Xeon® İşlemcili 8x NVIDIA HGX H200 H100 AI Sunucu

Intel Güvenilirliği, NVIDIA H100 Hızıyla Buluştu Supermicro SYS-821GE-TNHR, 4. ve 5. Nesil Intel® Xeon® Scalable işlemcilerin kurumsal gücünü, NVIDIA HGX™ H200 H100 8-GPU platformunun inanılmaz hızıyla birleştirir. Yapay zeka eğitiminde endüstri standardı olan bu 8U süper bilgisayar, mevcut Intel tabanlı veri merkezinize sorunsuz entegre olurken, ChatGPT ölçeğindeki yapay zeka modellerini eğitmeniz için gereken gücü sağlar.

Supermicro AS-8125GS-TNHR | 8x NVIDIA HGX H200 / H100 GPU Destekli Yapay Zeka Sunucusu

Yapay Zekanın Zirvesi: HGX H100 Mimarisi Supermicro AS-8125GS-TNHR, standartların ötesine geçerek yapay zeka eğitiminde (AI Training) dünya rekorlarını kıran NVIDIA HGX H200 / H100 8-GPU platformunu sunar. Çift AMD EPYC™ 9004 işlemci gücüyle birleşen bu 8U dev, ChatGPT benzeri Büyük Dil Modelleri (LLM), otonom sürüş simülasyonları ve karmaşık bilimsel araştırmalar için Türkiye’de bulabileceğiniz en güçlü altyapı çözümüdür.

UFM Telemetry Platform for NVIDIA® InfiniBand Switches

NVIDIA® InfiniBand Anahtarları için UFM Telemetri Platformu, Gerçek Zamanlı İzlemeyi Destekler.

Ürün Özellikleri

- Anahtarlar, Adaptörler, Kablolar Telemetri

- Sistem Doğrulaması

- Ağ Performans Testleri

- Telemetri Verilerini Şirket İçi veya Bulut Veritabanlarına Aktarın

UFM Enterprise Platform for NVIDIA® InfiniBand Switches

NVIDIA® InfiniBand Anahtarları için UFM Enterprise Platformu, Gerçek Zamanlı İzleme, Yapı Görünürlüğü ve Kontrolü Destekler.

Ürün Özellikleri

- UFM Telemetri İçeride

- Otomatik Ağ Keşfi ve Doğrulaması

- Güvenli Kablo Yönetimi

- Trafik Tıkanıklığı Takibi Trafik Darboğazlarını Belirleme

- Zengin Web tabanlı GUI

UFM Cyber-AI Platform for NVIDIA® InfiniBand Switches

NVIDIA® InfiniBand Anahtarları için UFM Cyber-AI Platformu, Gerçek Zamanlı İzleme, Yapı Görünürlüğü ve Kontrolü, Siber Zeka ve Analitiği Destekler.

NVIDIA MQM9790 Unmanaged Quantum-2 NDR Switch | GTM Teknoloji

Büyük ölçekli AI ve HPC kümeleri için optimize edilmiş, harici yönetim gerektiren (Unmanaged) 64 Portlu 400Gb/s NDR InfiniBand Switch. NVIDIA Quantum-2 teknolojisinin 51.2Tb/s gücünü, merkezi UFM yönetimi ile birleştirerek maliyet ve enerji verimliliği sağlar.

NVIDIA QM9700 Quantum-2 64-Port 400G NDR InfiniBand Switch | GTM Teknoloji

Yapay Zeka ve Süper Bilgisayar (HPC) altyapıları için dünyanın en gelişmiş anahtarı. NVIDIA Quantum-2 teknolojisi ile donatılmış, 64 portlu 400Gb/s NDR InfiniBand bağlantısı sunan, 51.2Tb/s toplam kapasiteye sahip yönetilebilir switch. In-Network Computing özelliği ile veri işleme performansını zirveye taşır.

Supermicro HGX B200 8-GPU Server | SYS-A22GA-NBRT

Bu SuperServer SYS-A22GA-NBRT, yapay zeka (AI) eğitimi, büyük dil modelleri (LLM) ve yüksek performanslı bilgi işlem (HPC) gibi yoğun iş yükleri için tasarlanmış 10U rack tipi bir GPU sistemidir.

Çift Intel Xeon 6900 serisi işlemcilerle güçlendirilen bu sistem, üstün hesaplama performansı sunmak üzere aynı anda 8 adede kadar NVIDIA HGX B200 GPU’yu destekler.

Supermicro HGX B200 8-GPU Server | SYS-822GS-NBRT 8U

Supermicro’nun NVIDIA HGX B200 8-GPU mimarisine sahip bu 8U sunucusu, Yapay Zeka (AI), Büyük Dil Modeli (LLM) geliştirme ve Derin Öğrenme Eğitimi için tasarlanmış en üst düzey HPC çözümüdür. Yüksek yoğunluklu PCIe 5.0 ve Titanium Seviye güç verimliliği ile veri merkezinizin performansını ve ölçeklenebilirliğini zirveye taşıyın.

NVIDIA H200NVL NVLink 141GB HBM3e PCIe | 900-21010-0040-000

$32.500,00 + KDVNVIDIA H200 NVL: Generative AI ve LLM’ler İçin 564 GB Birleşik Bellek Gücü

NVIDIA H200 NVL, Hopper™ Mimarisi tabanlı, kurumsal veri merkezleri için tasarlanmış en yeni PCIe form faktörlü Tensor Core GPU’dur. Büyük Dil Modelleri (LLM) çıkarımında önceki nesile göre 1.7 kata kadar hız sunarak, yapay zeka iş yüklerinizi rekor sürede tamamlayın. 141 GB ultra hızlı HBM3e bellek ve 4.8 TB/s bant genişliği ile dünyanın en büyük modellerini kolayca çalıştırın. 4-yollu NVLink desteği sayesinde, tek bir sunucuda 564 GB’a kadar birleşik (pooled) GPU belleği oluşturarak performanstan ödün vermeden ölçeklenin. Hava soğutmalı tasarımı, mevcut kurumsal raflarınıza sorunsuz entegrasyon ve üstün enerji verimliliği sağlar. NVIDIA AI Enterprise yazılımı ile birlikte sunulan H200 NVL, yapay zekanın geleceğini bugünden yakalamak isteyen işletmeler için idealdir.